关于DeepLearning超级对话模型ChatGPT的调研

关于DeepLearning超级对话模型ChatGPT的调研

本次新生研讨课上,老师由AlphaFold 2—–深度学习在生物信息学的应用,向我们介绍了深度学习发展的三个关键驱动力,。不禁使我联想到深度学习在其他各个领域里都有广阔的天地。于是我对ChatGPT这样一个语言处理和对话模型进行调研。

1. 起源与功能

早在2018年,自然语言处理 NLP 领域也步入了 LLM 时代,谷歌出品的 Bert 模型横空出世,碾压了以往的所有模型,直接在各种NLP的建模任务中取得了最佳的成绩。Bert 所作的事就是从大规模的上亿的文本预料中,随机地扣掉一部分字,形成上面例子的完形填空题型,不断地学习空格处到底该填写什么。

同时人工智能实验室Open AI发布了初代GPT,逐渐演化超越了Bert,成为了今天的ChatGPT,在一定程度上,ChatGPT可以说是自AI概念提出以来,普及度最为广泛的一款AI应用。

它是基于Transformer算法架构开发的一个大型预训练语言模型,能完成包括写代码、创作菜谱、做作业、写小说、创作商业文案等一系列常见的文字输出型任务。Open AI对其对定位为聊天机器人,与其他使用预定义的响应或规则生成文本的聊天机器人不同的是,ChatGPT在经过了大量的数据训练之后,可以根据接收到的输入生成响应,从而生成更自然、更多样化的响应。

2. 原理简析

基础原理上Bert和ChatGPT是相似的,都是基于 Transformer 这种编码器,获取了文本内部的相互联系。人们使用语言一般包括三个步骤:

接受听到或读到的语言 -> 大脑理解 -> 输出要说的语言。

因此,大脑理解语言这个过程,就是大脑将语言编码成一种可理解、可存储形式的过程,这个过程就叫做语言的编码。

模型的训练:

初代预训练任务仅仅是一个完形填空任务就可以让语言模型有了极大进步,那么,很多人就想,给模型出其它的语言题型,应该也会有极大的帮助。于是句子打乱顺序再排序、选择题、判断题、改错题、把预测单字改成预测实体词汇等等,纷纷都可以制定数据集添加在模型的预训练里。

3. ChatGPT崛起的源头

而ChatGPT能走到如此强大,最关键在于远超所有NLP模型的训练数据量GPT里的大模型计算量是 Bert 的上千倍。统统这些都是在燃烧的金钱,真就是 all you need is money。

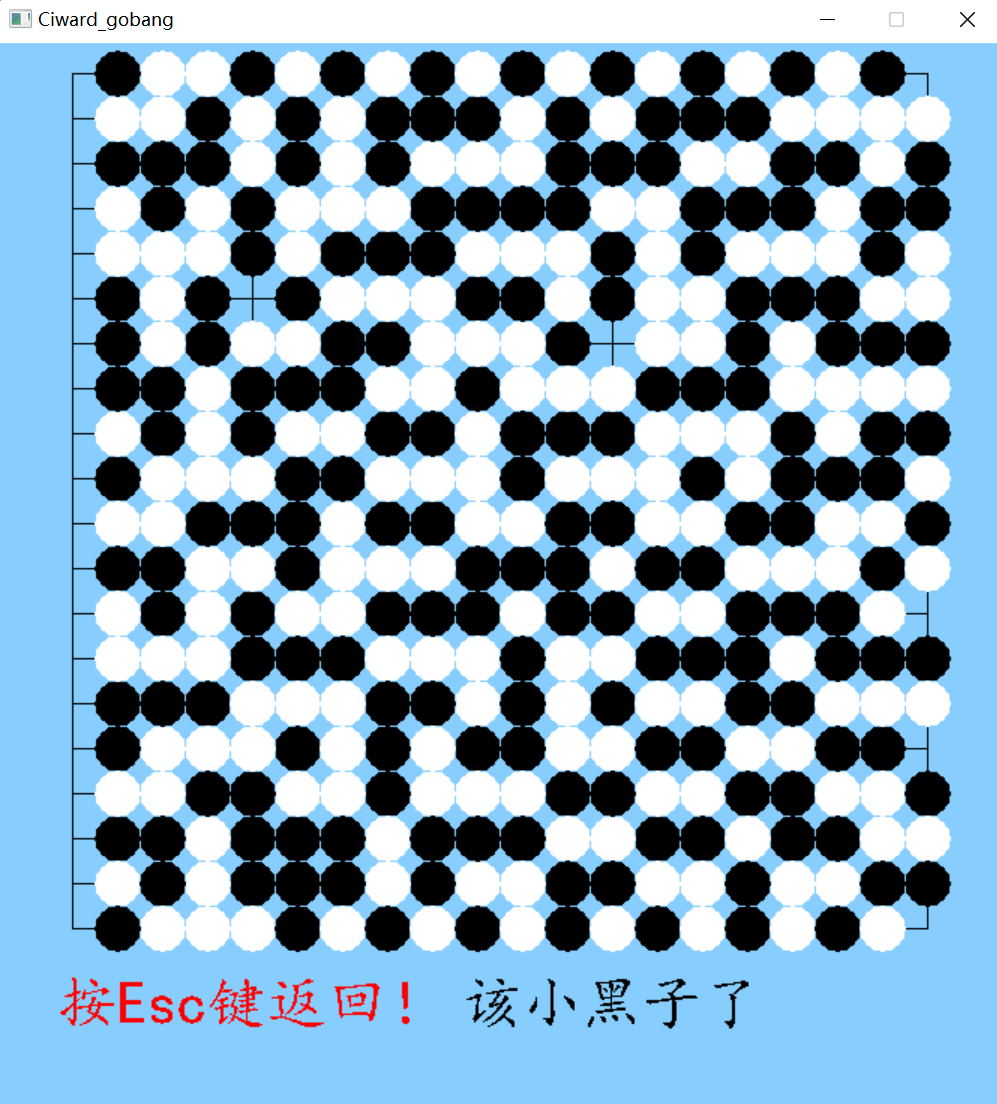

不仅如此,ChatGPT训练策略也变了,用上了强化学习。强化学习的alpha GO 击败了柯洁,几乎可以说明,强化学习如果在适合的条件下,完全可以打败人类,逼近完美的极限。

强化学习非常像生物进化,模型在给定的环境中,不断地根据环境的惩罚和奖励(reward),拟合到一个最适应环境的状态。然而这对于NLP来说却困难重重。原因就是,NLP 所依赖的环境,是整个现实世界,整个宇宙万物,都可以被语言描述,也就都需要针对模型输出的质量进行 reward 评价,它完全无法设计反馈惩罚和奖励函数。除非人们一点点地人工反馈。

可是有钱任性,OpenAI 的 ChatGPT就撒钱,找40个外包,让那40名外包人员不断地从模型的输出结果中筛选,判断哪些句子是好的,哪些是低质量的,这样就可以训练得到一个 reward 模型。而这个reward 模型一旦生产,就能一直迭代下去,而ChatGPT只需要不断地拟合这个reward,形成了他自己的语言博弈。